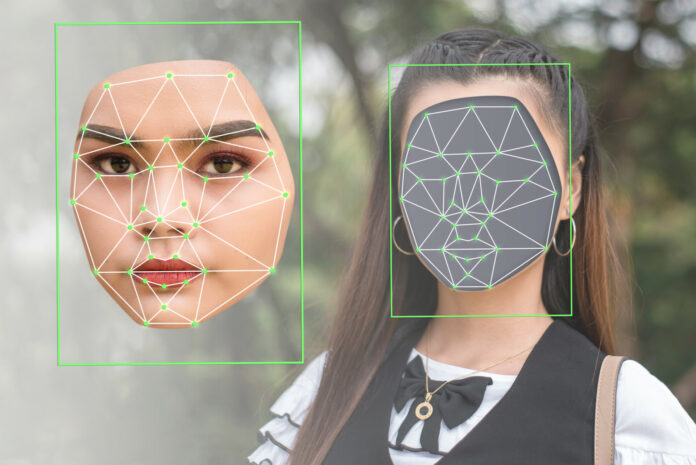

Η τεχνητή νοημοσύνη (AI) έχει δώσει τη δυνατότητα για εξελιγμένες απομιμήσεις προσώπων, που σε πολλές περιπτώσεις είναι δύσκολο να επαληθευθεί αν η εικόνα είναι αληθινή.

Αρκετές φωτογραφίες, ψεύτικες και τελειοποιημένες, έχουν γίνει viral τους τελευταίους μήνες. Μία τέτοια φωτογραφία έδειχνε τον Πάπα Φραγκίσκο με ένα «πουπουλένιο τζάκετ». Μια άλλη ψεύτικη εικόνα υποτίθεται ότι απαθανάτιζε τη σύλληψη του πρώην προέδρου των Ηνωμένων Πολιτειών Ντόναλντ Τραμπ.

Το μεγάλο πρόβλημα είναι ότι οι ψεύτικες απομιμήσεις μπορούν να καταστρέψουν τη φήμη των ανθρώπων ή να χρησιμοποιηθούν για πράξεις εκφοβισμού ή παρενόχλησης.

Σύμφωνα με μια μελέτη της ολλανδικής εταιρείας Sensity, που ειδικεύεται στην τεχνητή νοημοσύνη, το 96% των ψεύτικων βίντεο στο διαδίκτυο αφορούν γυναίκες: διασημότητες όπως η τραγουδίστρια Τέιλορ Σουίφτ ή η ηθοποιός Εμα Γουάτσον είναι ανάμεσα στις πολλές προσωπικότητες του καλλιτεχνικού κόσμου που έχουν πέσει θύματα ψηφιακής απομίμησης σε deepfake πορνό.

Πολύ διαδεδομένη είναι η χρήση των αλγορίθμων για τη δημιουργία πορνογραφικού περιεχομένου, εν αγνοία των στοχευμένων προσώπων, των οποίων οι ζωές μερικές φορές καταστρέφονται, πιστεύουν οι ειδικοί. Και οι γυναίκες είναι τα πρώτα θύματα.

«Η άνοδος του πορνό που δημιουργείται από την τεχνητή νοημοσύνη κανονικοποιεί τη χρήση της εικόνας ή της ομοιότητας μιας γυναίκας χωρίς τη συγκατάθεσή της», λέει η Σόφι Μέντοκς, ερευνήτρια στο Πανεπιστήμιο της Πενσυλβάνια που παρακολουθεί τη σεξουαλική κακοποίηση που σχετίζεται με εικόνες. «Ως κοινωνία, τι μήνυμα στέλνουμε για τη συναίνεση, όταν μπορεί κάποιος ουσιαστικά να γδύσει οποιαδήποτε γυναίκα;» διερωτάται.

Τα αμερικανικά και ευρωπαϊκά μέσα ενημέρωσης είναι γεμάτα άλλωστε με μαρτυρίες γυναικών ακαδημαϊκών ή ακτιβιστών που σοκαρίστηκαν όταν ανακάλυψαν τα πρόσωπά τους σε ανάρμοστες εικόνες. «Η πολύ ιδιωτική σεξουαλική φαντασίωση, που κάποτε αναπτύχθηκε στη φαντασία ενός ατόμου, μεταφέρεται τώρα στους δημιουργούς τεχνολογίας και περιεχομένου στον πραγματικό κόσμο», λέει η Ρομπέρτα Ντάφιλντ,διευθύντρια τεχνητής νοημοσύνης στην Blackbird.AI.

«Η ευκολία πρόσβασης και η έλλειψη παρακολούθησης -καθώς και η αυξανόμενη επαγγελματοποίηση του κλάδου- αξιοποιούν αυτές τις τεχνολογίες σε νέες μορφές εκμετάλλευσης και αποδυνάμωσης των γυναικών», επισημαίνει η Ντάφιλντ.

«Κορίτσια τεχνητής νοημοσύνης»

Μεταξύ των νέων δημιουργών τέχνης κειμένου είναι δωρεάν εφαρμογές που μπορούν να δημιουργήσουν «υπερπραγματικά κορίτσια τεχνητής νοημοσύνης» – avatars από πραγματικές φωτογραφίες, τα οποία μπορεί κανείς να προσαρμόσει στις προτιμήσεις του.

Νέες τεχνολογίες όπως το Stable Diffusion, ένα μοντέλο τεχνητής νοημοσύνης ανοιχτού κώδικα που αναπτύχθηκε από την Stability AI, επιτρέπουν ρεαλιστικές εικόνες από περιγραφές κειμένου.

Η πρόοδος της τεχνολογίας οδήγησε σε αυτό που η Ντάφιλντ αποκαλεί «αναπτυσσόμενη ψηφιακή βιομηχανία» γύρω από το πορνό, που δημιουργείται από την τεχνητή νοημοσύνη, με πολλούς παίκτες να συμφωνούν να παράγουν περιεχόμενο – επί πληρωμή – με όποιον επιλέξει ο «πελάτης».

Τον περασμένο μήνα, το FBI προειδοποίησε για σεξουαλικό εκβιασμό, κατασκευασμένο από εικόνες που κυκλοφόρησαν στα μέσα κοινωνικής δικτύωσης και χρησιμοποιούνται για εκβίαση χρημάτων από τα θύματα ή τις οικογένειές τους, που μπορεί να είναι παιδιά.

Δεν υπάρχουν εργαλεία προστασίας

Η εξάπλωση τέτοιου είδους τροποποιημένου περιεχομένου τεχνητής νοημοσύνης έχει ξεπεράσει τις προσπάθειες των ΗΠΑ και της Ευρώπης να ρυθμίσουν αυτόν τον νέο τομέα της τεχνολογίας. Αντιμέτωπες οι αρχές με αυτόν τον πολλαπλασιασμό εργαλείων τεχνητής νοημοσύνης, κατανοούν ότι οι υπάρχοντες κανονισμοί είναι ξεπερασμένοι.

«Ο νόμος πρέπει να καλύψει τη διαφορά», λέει ο Ντάν Πάρσελ, Διευθύνων Σύμβουλος και ιδρυτής της εταιρείας προστασίας εμπορικών σημάτων Ceartas. «Δεν είναι μια σκοτεινή γωνιά του Διαδικτύου όπου δημιουργούνται και μοιράζονται αυτές οι εικόνες. Είναι ακριβώς κάτω από τη μύτη μας», τονίζει ο Πάρσελ, υποστηρίζοντας την ανάγκη για θέσπιση εναρμονισμένων διεθνών κανόνων. « Δυστυχώς, το Διαδίκτυο είναι μια δικαιοδοσία χωρίς σύνορα», προσθέτει.

Στη Μεγάλη Βρετανία, προετοιμάζεται ένα νέο νομοθετικό σχέδιο για την ποινικοποίηση της χρήσης πορνογραφικού περιεχομένου που διακινείται με αυτόν τον τρόπο.

Αμερικανοί βουλευτές εισήγαγαν Νόμο για την πρόληψη των λεγόμενων «Deepfakes of Intimate Images», ο οποίος θα καθιστά παράνομη την κοινή χρήση τέτοιου περιεχομένου χωρίς συγκατάθεση. Τέσσερις αμερικανικές πολιτείες, μεταξύ των οποίων η Καλιφόρνια και η Βιρτζίνια, έχουν ήδη απαγορεύσει τη διανομή τέτοιων εικόνων, αλλά τα θύματα συχνά έχουν ελάχιστες δυνατότητες να αντιδράσουν.